4. Ser estudiante en la era digital

4.1. Introducción a la inteligencia artificial generativa en el ámbito universitario

La irrupción de la inteligencia artificial generativa (IAG) en la cultura actual plantea el desafío de reconocer su potencial para integrarla de manera significativa en el contexto de la educación superior. Se trata de herramientas tecnológicas innovadoras con especificidades que exigen competencias digitales determinadas para un uso crítico, creativo y responsable, que enriquezca el proceso de enseñanza y aprendizaje universitario.

La IAG facilita el uso de un nuevo software que permite la producción de múltiples contenidos académicos: ensayos, resúmenes, presentaciones, pódcasts, videos, mapas conceptuales interactivos, etc. Esto representa un nuevo ecosistema tecnológico y pedagógico que reconfigura notablemente el acceso y la circulación de información y conocimientos; por lo tanto, es necesario trascender el abordaje instrumental para lograr un posicionamiento reflexivo desde lo ético, político y cultural.

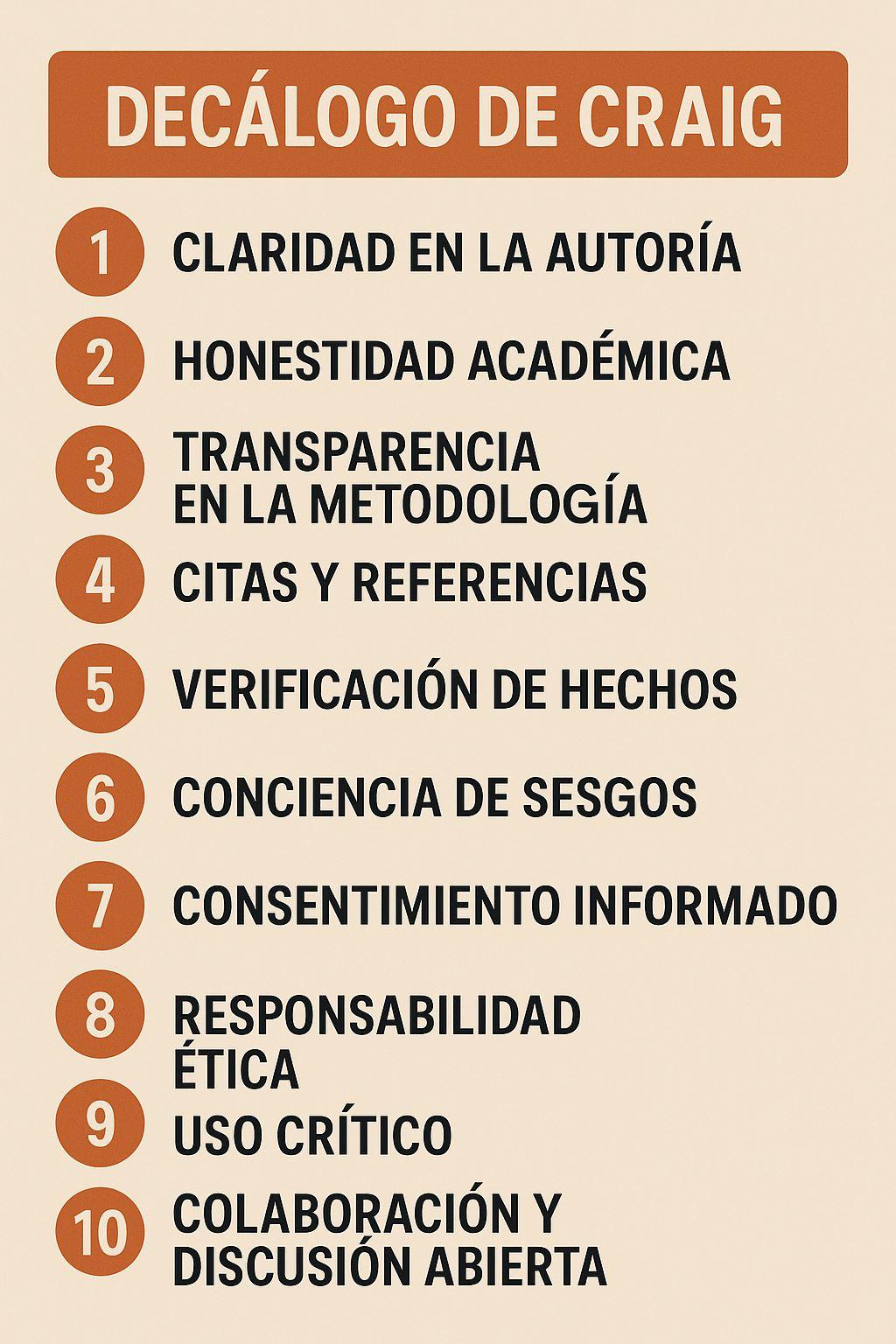

El decálogo diseñado por el argentino Diego Craig (2024) sobre transparencia y ética en el uso de la IA en el ámbito académico señala puntos claves para tener en cuenta (Figura 4.1).

Estos principios permiten identificar las acciones necesarias que todo usuario debe realizar frente al uso de IAG en la universidad y su impacto en tareas, en cómo se estudia, se escribe y se construye el conocimiento en las aulas del siglo XXI.

En América Latina, donde se estima que el 75 % del sector ya emplea estas herramientas, este fenómeno exige un análisis desde la perspectiva de la “soberanía digital” y el enfoque del pensamiento crítico. Es decir, no solo se trata de usar la tecnología, sino de comprender cómo funciona, quién la produce y qué implicancias tiene para nuestra región.

A diferencia de la IA tradicional, la IAG aprende estructuras estadísticas para producir contenidos nuevos como ensayos, código y resúmenes, funcionando como un andamiaje cognitivo que potencia las capacidades humanas sin perjudicarlas. En otras palabras, puede ayudar a organizar ideas, mejorar la redacción o resumir textos, pero no reemplaza el proceso de aprendizaje del estudiante.

Por ejemplo, un estudiante puede pedirle a una herramienta de IA que le explique un concepto difícil o que le ayude a ordenar un texto. Sin embargo, comprender ese concepto y poder explicarlo con sus propias palabras sigue siendo una tarea fundamental del aprendizaje.

Con el transcurso de los años, esta tecnología se ha consolidado como un instrumento transformador que optimiza la estructuración de ideas y disminuye errores sintácticos, y que promueve la autonomía del estudiante. Herramientas como ChatGPT, Gemini y Copilot, por mencionar algunos ejemplos, están modificando la interacción entre docentes y estudiantes, funcionando como “copilotos pedagógicos” que facilitan el acceso a tecnologías innovadoras.

Sin embargo, es vital que el estudiante desarme el concepto de “caja negraN”: entender que la IA no “piensa”, sino que predice la palabra más probable basándose en modelos probabilísticos. Esto implica que puede generar textos coherentes, pero también cometer errores o brindar información inexacta.

La expresión “caja negra” se utiliza con un sentido metafórico para referirse a un sistema cuyo funcionamiento interno se desconoce.

Por ejemplo, una IA puede redactar un texto que parece correcto, pero incluir datos incorrectos o desactualizados. Por eso, es fundamental revisar, contrastar y validar la información, apelando en todo momento al pensamiento crítico de parte del usuario.

Además, autores como Ezequiel Molina y Cristóbal Cobo (Molina et al., 2024) advierten que estas herramientas, entrenadas mayoritariamente con datos del “Norte Global”, pueden invisibilizar las particularidades culturales de nuestra región. Por ello, se requiere un “conocimiento situado” donde el estudiante sea capaz de intervenir los textos generados con estadísticas y realidades locales. En este sentido, por ejemplo, si se solicita un análisis económico, es importante adaptarlo al contexto argentino o latinoamericano, mediante la incorporación de datos y problemáticas propias de la región.

4.2. Desafíos éticos y usos responsables

A partir de lo desarrollado en el apartado anterior, donde se presentó a la inteligencia artificial generativa como una herramienta con gran potencial para acompañar el aprendizaje, resulta necesario profundizar en las implicancias de su uso en el ámbito académico.

Estudiar en la universidad requiere la lectura, el análisis, escritura, exposición, debate y pensamiento crítico de distintas fuentes informativas. Las herramientas de IAG pueden realizar todo eso, por lo que es necesario priorizar que docentes y estudiantes desarrollen capacidades que eviten la dependencia algorítmica, copiar y pegar y reproducir información. El uso responsable de la IAG debe partir de una comprensión crítica de la información, la validación de datos, el reconocimiento de limitaciones, sesgos y dilemas éticos, así como de prácticas educativas basadas en la producción y circulación de saberes genuinos que faciliten la democratización y la discusión de ideas en el marco de la universidad pública.

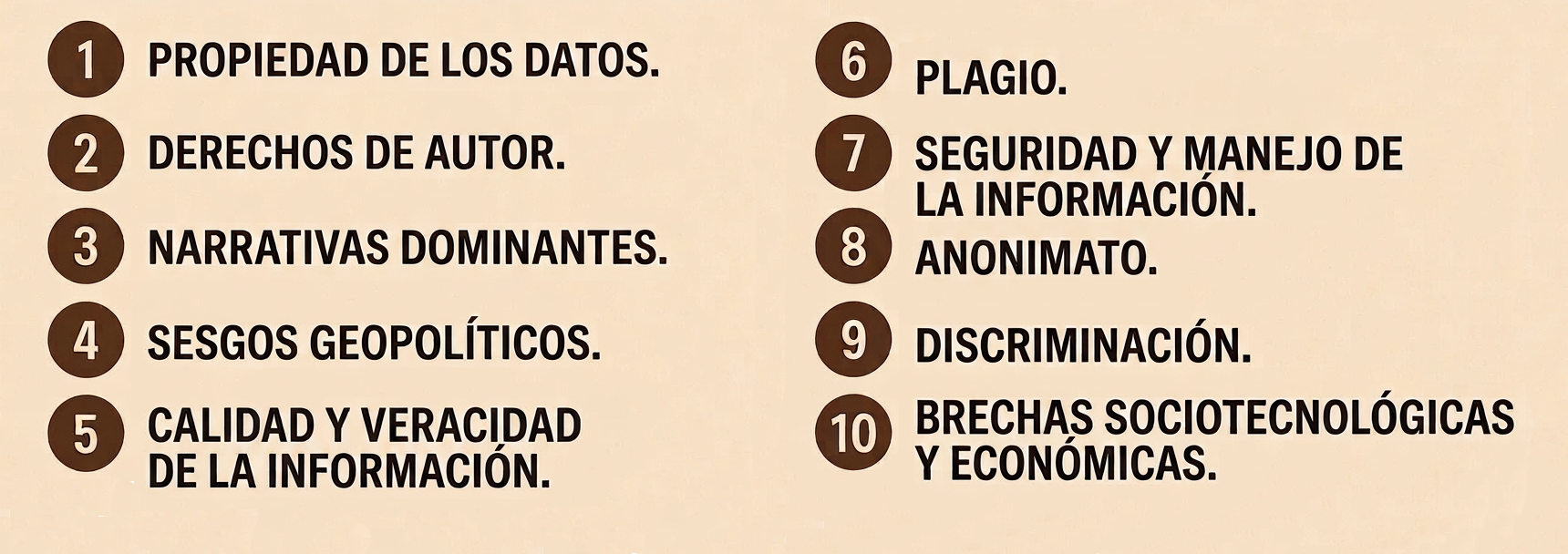

Las dimensiones a tener en cuenta en el uso de la IAG en el ámbito universitario se mencionan en la Figura 4.2.

Existe una diversidad de recursos de IAG; ChatGPT es una herramienta de uso muy frecuente en el ámbito educativo. Es necesario tener en cuenta que redactar textos académicos para la universidad implica consultar distintas fuentes informativas, analizarlas, identificar autores, citar correctamente y evitar el copiado y pegado. Cada estudiante debe ser el autor del contenido académico que formula; la IA puede ayudar, pero se necesita “honestidad intelectual y autonomía” para producir argumentos propios.

El uso de citas textuales y de paráfrasis, según las Normas APA, es clave para evitar incurrir en plagio, es decir la apropiación indebida de información de terceros. Desarrollar habilidades para un uso responsable de los contenidos que ofrece IAG constituye una dimensión muy importante para el estudio en nuestra universidad. En este sentido identificar mecanismos digitales de exclusión social y desigualdad, como estereotipos de género, raza, clase social o tendencias político-culturales dominantes, en los resultados que ofrece.

La IAG puede facilitar la comprensión de contenidos, la organización de ideas y la producción de textos; no obstante, su incorporación en la vida universitaria también plantea una serie de desafíos que exceden lo técnico y se vinculan directamente con la ética y la responsabilidad del estudiante. Esta última no solo refiere al cumplimiento de consignas, sino a la construcción de un posicionamiento crítico frente a las herramientas utilizadas. El uso de la IA debe regirse por la transparencia y el principio de que la escritura es una herramienta de aprendizaje. Es decir, escribir no es solo un requisito académico, sino una forma de pensar, comprender y apropiarse del conocimiento.

En América Latina, redes como la Red de Lectura y Escritura en la Educación Superior (REDLEES) enfatizan que, si el estudiante no escribe, no procesa el conocimiento. Por ello, se debe asegurar que la IA acompañe el proceso de aprendizaje y no actúe como una herramienta que lo remplace.

A continuación, se presentan algunos de los principales retos éticos en relación con la utilización de la IA en el ámbito académico:

-

Sesgos y prejuicios. Los algoritmos pueden reproducir estereotipos de género, raza o clase social, lo que requiere una “vigilancia epistemológica” por parte del usuario. Es responsabilidad del estudiante identificar si la IA está reproduciendo algún tipo de sesgo y/o prejuicio. Por ejemplo, una respuesta puede presentar una visión parcial o estereotipada sobre ciertos grupos sociales.

-

Privacidad y gobernanza de datos. Es imperativo no subir datos sensibles o propiedad intelectual a plataformas comerciales, y garantizar el cumplimiento de las normativas de privacidad. Por ejemplo, no se deben cargar trabajos propios inéditos, datos personales o información institucional confidencial.

-

Integridad académica y coautoría. El estudiante debe ser el autor intelectual de sus entregas. La IA puede apoyar en la redacción o gramática, pero no debe decidir el argumento central ni sustituir el trabajo intelectual. Por ejemplo, usar IA para corregir un texto es válido, pero entregar un trabajo generado íntegramente por IA no respeta las normas académicas.

-

Equidad digital. Existe un riesgo de que la falta de conectividad o dispositivos adecuados agrave las desigualdades educativas preexistentes. Esto implica que no todos los estudiantes tienen las mismas posibilidades de acceso a estas herramientas.

En síntesis, el uso responsable de la IA implica tomar decisiones conscientes, críticas y éticamente fundamentadas sobre cuándo y cómo utilizarla.

4.3. Ingeniería de prompts: el prompt como “socio en la reflexión”

En línea con los desafíos éticos y la necesidad de un uso responsable de la inteligencia artificial, resulta clave comprender no solo qué hacer con estas herramientas, sino también cómo interactuar con ellas de manera adecuada.

En este sentido, el prompt engineering (ingeniería de instrucciones) se ha consolidado como una competencia de alfabetización digital básica, ya que permite orientar el uso de la IA en forma consciente, crítica y alineada con los objetivos de aprendizaje.

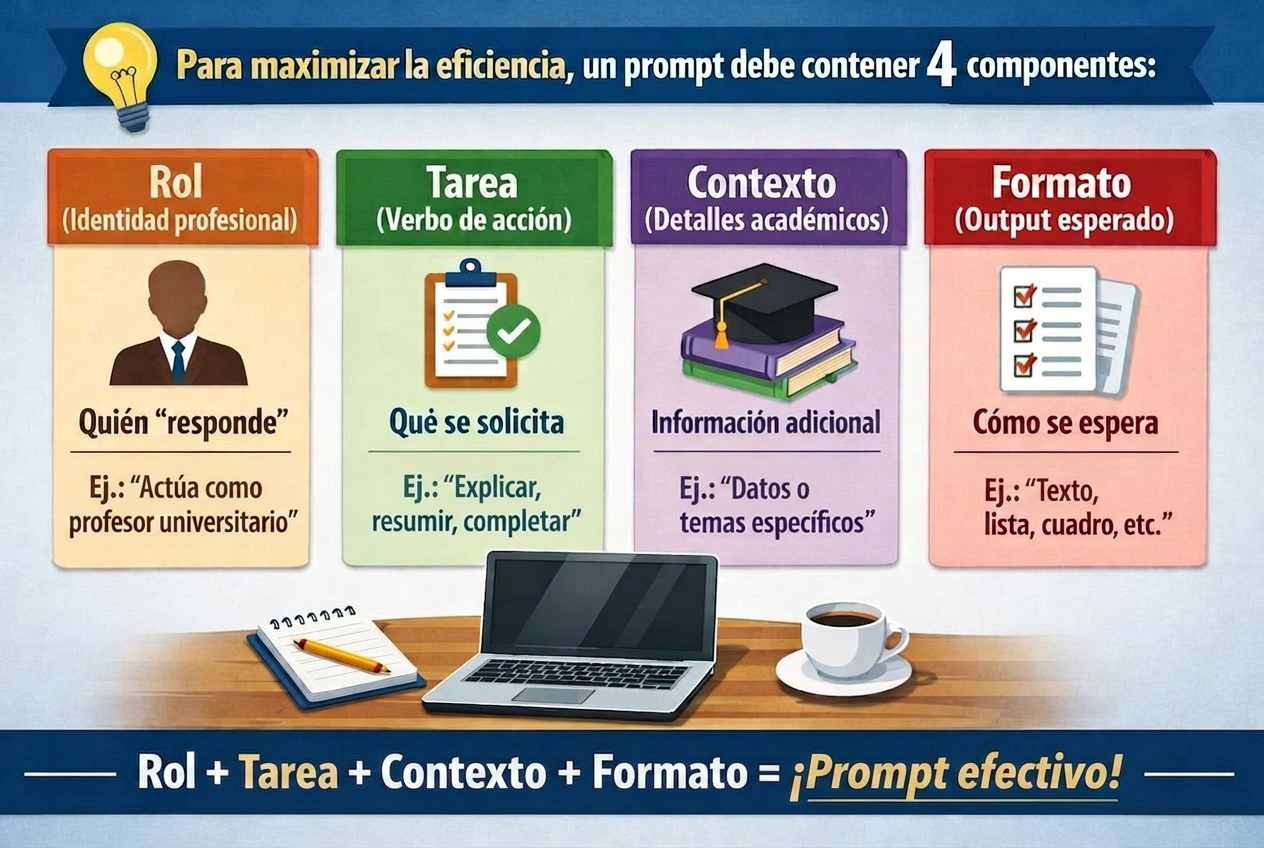

Un prompt no es una simple orden, sino una pregunta clara y específica que, a modo de brújula, orienta una búsqueda más relevante (Figura 4.3). Constituye la forma en que el usuario se comunica con la inteligencia artificial. Por lo tanto, cuanto más claro y detallado sea, mejores serán los resultados obtenidos.

Siguiendo esta estructura, un ejemplo de prompt podría ser: “Actúa como profesor de administración y explica el concepto de organización formal con un ejemplo sencillo en formato de párrafo”.

Además de la propuesta de la Figura 4.2, existen diversos modelos de trabajo para optimizar esta interacción, como el RTF (Rol - Tarea - Formato), TAG / TAO (Tarea - Acción - Objetivo), CARE (Contexto - Acción - Resultados - Ejemplos), RISE (Rol - Input - Pasos - Expectativa) y RITA (Rol - Información - Tarea - Adaptabilidad). Estos ayudan a estructurar mejor las consignas y obtener respuestas más útiles.

En lo que refiere a dinámicas de interacción con la IA que eviten la sustitución de la producción propia, se propone el “prompting iterativo”, que se divide generalmente en las siguientes fases:

-

Exploración. Solicitar explicaciones conceptuales. Por ejemplo: “Actúa como tutor y explica el concepto de cultura organizacional”.

-

Profundización (refinamiento). Indagar en críticas o debates teóricos sobre el tema. Por ejemplo: “¿Qué críticas existen sobre este concepto?”.

-

Aplicación (ejecución). El estudiante redacta ejemplos o aplicaciones basadas en la información organizada y se asegura de que el juicio crítico siga siendo propio.

De este modo, la IA actúa como un “socio” que ayuda a identificar contradicciones, ampliar perspectivas o generar glosarios personalizados, pero la redacción final y la tesis pertenecen al estudiante.

4.4. Hacia una cultura digital responsable

La inteligencia artificial se posiciona como una innovación revolucionaria con el potencial de mejorar la calidad del aprendizaje y la investigación. No obstante, su impacto estará sujeto a la manera en que sea utilizada, dependiendo de la formación continua de docentes y estudiantes en alfabetización algorítmica y ética. Esto implica no solo aprender a usar estas herramientas, sino también comprender sus límites, riesgos y posibilidades.

En este sentido, la tecnología debe ser un recurso complementario enriquecedor y no un sustituto del pensamiento humano y la tradición educativa. El desafío no es evitar la IA, sino integrarla de manera crítica, responsable y consciente en las prácticas académicas. Debe ser una base para la generación de ideas y un potenciador del proceso creativo, no un sustituto.

Ahora bien, este uso crítico no se agota en la relación individual entre el estudiante y la herramienta. Cada interacción con la IA –los textos que producimos, las decisiones que tomamos, los contenidos que validamos o cuestionamos– deja una marca en nuestra forma de aprender y también en nuestra presencia en entornos digitales.

En otras palabras, el uso de la IA no solo impacta en cómo estudiamos, sino también en cómo nos posicionamos como estudiantes dentro de la comunidad universitaria. Esto nos invita a ampliar la mirada: pasar del uso de herramientas a la construcción de una ciudadanía digital universitaria responsable.

Así, la reflexión sobre la inteligencia artificial se conecta directamente con la idea de huella digital académica: aquello que producimos, compartimos y validamos en entornos virtuales forma parte de nuestra identidad como estudiantes y futuros profesionales. Por ello, resulta fundamental no solo saber utilizar estas tecnologías, sino también comprender las implicancias éticas, sociales y académicas de nuestra participación en el ecosistema digital.

Este enfoque nos conduce al siguiente eje, donde se profundiza el rol del estudiante como ciudadano digital, capaz de construir una identidad académica crítica, responsable e inclusiva en los entornos virtuales de aprendizaje.

4.5. Ciudadanía universitaria digital y huella digital académica

La ciudadanía digital en el ámbito universitario trasciende el simple uso de dispositivos; implica el ejercicio pleno de derechos y deberes, así como la construcción de una identidad profesional ética en entornos mediados por la tecnología. Es decir, no alcanza con saber usar una computadora o una plataforma virtual: también es necesario comprender cómo participar de manera responsable, respetuosa y crítica en estos espacios.

En relación con lo anterior, se define al ciudadano digital como aquella persona capaz de ejercer sus derechos basándose en principios críticos y éticos para impulsar cambios sociales. En la educación superior, esto implica, por ejemplo, participar en foros de manera respetuosa, citar correctamente las fuentes o cuidar la información que se comparte.

En este contexto, nuestra “huella digital” no es solo un rastro de navegación pasivo, sino el registro histórico de nuestra evolución intelectual y un patrimonio que debe ser protegido (seguridad de datos) y cultivado (calidad de los aportes). Los trabajos realizados, las intervenciones en foros o incluso las consultas académicas forman parte del recorrido que realizan las personas en su rol de estudiantes.

4.5.1. Construcción de la identidad académica y alfabetización digital crítica

La identidad digital académica en instituciones como la Universidad Nacional de Quilmes se construye desde el primer ingreso al campus virtual. Este proceso no es estático, sino un ejercicio de subjetivación digital intencional donde cada intervención en foros o perfiles institucionales forma parte de un “currículum invisible”.

Esto significa que, aunque no siempre sea evidente, todo lo que realiza el estudiante en el entorno virtual (cómo escribe, cómo argumenta, cómo interactúa con otros) va construyendo su perfil académico.

Por ejemplo, un estudiante que participa activamente en los foros con aportes fundamentados y respetuosos está construyendo una identidad académica sólida.

Para que esta identidad sea consistente, es imperativo desarrollar la alfabetización digital crítica (ADC), la cual propone superar la dimensión puramente técnica para enfocarse en lo social y político. No se trata solo de “saber usar herramientas”, sino de comprender sus implicancias.

La ADC se despliega en tres fases fundamentales:

-

Desnaturalización. Cuestionar la normalización de las tecnologías en la vida cotidiana y reconocer que la socialización tecnológica no es igual para todos debido a brechas económicas o culturales. Por ejemplo, no todos los estudiantes tienen el mismo acceso a dispositivos o conexión a internet.

-

Problematización. Interrogar las prácticas digitales habituales, analizando sesgos, algoritmos y estructuras de poder que median la experiencia en red. Por ejemplo, preguntarse por qué ciertas publicaciones tienen más visibilidad que otras.

-

Propuestas alternativas. Asumir un rol activo para promover una ciudadanía digital justa y reclamar derechos en el ecosistema digital. Por ejemplo, promover prácticas inclusivas o denunciar situaciones de discriminación en entornos virtuales.

4.5.2. Trayectorias estudiantiles, participación y autogestión en entornos virtuales

Una vez comprendida la importancia de la construcción de la identidad digital académica, resulta necesario analizar cómo esta se desarrolla en la práctica a lo largo de la trayectoria estudiantil.

En este sentido, los entornos virtuales de enseñanza y aprendizaje (EVEA) no son espacios aislados, sino escenarios donde esa identidad se pone en juego a través de la participación, la producción y la interacción con otros. No son repositorios pasivos, sino espacios de construcción colaborativa. Esto implica que no solo se “recibe” información, sino que también se produce y se comparte conocimiento con otros.

Hoy, entonces, la trayectoria estudiantil es híbrida y bimodal, dado que lo que sucede en el aula física se expande y profundiza en la virtualidad. Por ejemplo, un tema desarrollado en una clase presencial puede continuar en un foro, en una actividad virtual o en un trabajo colaborativo en línea.

Para transitar estas trayectorias con éxito, el estudiante debe evolucionar de ser un receptor pasivo a un “prosumidor” de conocimientos, capaz de producir contenidos multimedia (pódcasts, videos, mapas interactivos) como evidencia de sus competencias. Por ejemplo, en lugar de solo leer un texto, un estudiante puede realizar un breve video explicando un concepto o un mapa conceptual digital.

Un factor determinante en este proceso es la autogestión para el aprendizaje. Un estudiante autogestivo es aquel que regula su propio ritmo, organiza sus tiempos de estudio frente a las demandas laborales o familiares, y posee una alta capacidad metacognitiva para evaluar su proceso de apropiación del conocimiento. En términos simples, implica planificar cuándo estudiar, revisar qué se entendió y qué no, y buscar estrategias para mejorar.

Las instituciones educativas que aplican la bimodalidad suelen apoyar este proceso a través de instancias formativas previas al inicio de clases, que buscan transformar al estudiante tradicional en uno virtual mediante la nivelación de sus competencias digitales y de lectura y escritura crítica.

4.5.3. Responsabilidad, convivencia y prevención de violencias digitales

La participación activa en entornos virtuales no solo implica producir y compartir conocimientos, sino también convivir con otras personas en un espacio común.

Por ello, la ciudadanía digital universitaria supone desarrollar prácticas de interacción basadas en el respeto, la responsabilidad y el reconocimiento de la diversidad. Esto conlleva interactuar de manera respetuosa, incluso cuando hay desacuerdos.

El “buen vivir digital” implica actuar bajo valores de solidaridad, honestidad e identidad. Por ejemplo, respetar las opiniones de otros, no difundir información falsa y reconocer las fuentes utilizadas.

No obstante, la interconexión también genera desafíos en torno a la conflictividad y violencia digital, manifestada en fenómenos como el ciberacoso, la transfobia o los “escraches” en redes. Por ejemplo, los comentarios ofensivos en foros, las burlas o la difusión de información privada sin consentimiento son formas de violencia digital.

Ante esto, las instituciones educativas trabajan en la construcción de una ciudadanía digital democrática mediante los siguientes instrumentos:

-

Interagencialidad. Trabajo conjunto entre docentes, estudiantes y autoridades para abordar problemas complejos. Por ejemplo, ante una situación de conflicto, es importante que exista un espacio de diálogo entre todas las partes.

-

Mediación pedagógica. Uso de la tecnología para transformar contradicciones en oportunidades de aprendizaje y autorregulación. Por ejemplo, convertir un debate en un espacio de reflexión guiado.

-

Privacidad y consentimiento. Protección de la propiedad intelectual y prohibición de difundir capturas de pantalla o grabaciones sin autorización expresa. Esto incluye respetar la privacidad de compañeros y docentes en entornos virtuales.

4.5.4. Accesibilidad universal e inclusión como derecho humano

Pensar en la convivencia digital desde una perspectiva ética también implica considerar quiénes pueden participar y en qué condiciones.

En este sentido, la accesibilidad y la inclusión se vuelven aspectos fundamentales para garantizar una ciudadanía digital plena, donde todos los estudiantes tengan las mismas oportunidades de acceso y participación.

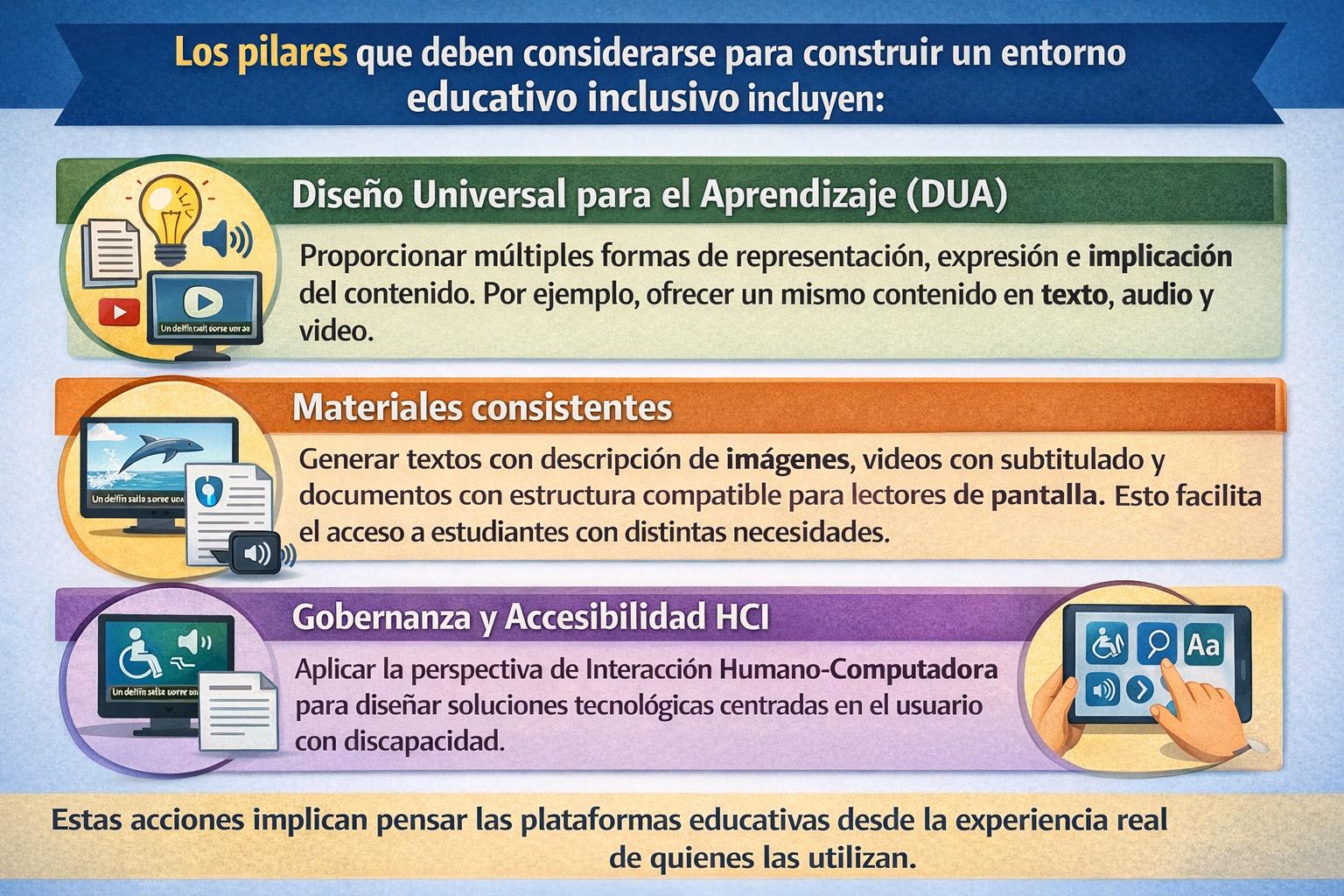

La inclusión en la educación superior es una cuestión de derechos humanos y justicia social. Un entorno virtual que no cumple con normas de accesibilidad digital se convierte en un espacio excluyente.

La accesibilidad implica diluir barreras físicas, sensoriales y cognitivas mediante la implementación de estándares internacionales como las WCAG (Pautas de Accesibilidad al Contenido en la Web). En términos simples, se trata de que todas las personas, independientemente de sus capacidades, puedan acceder y participar en igualdad de condiciones.